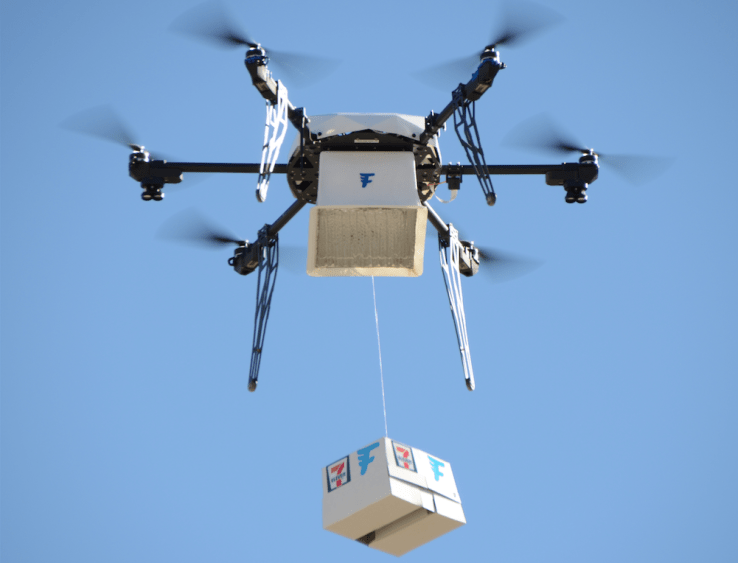

セブンイレブンがネバダ州でドローン配達大成功 ― フローズンやチキンサンド、ドーナツ、ホットコーヒーも

7-Eleven delivers by drone in Reno including, yes, Slurpees

売り上げランキング: 77,263

7-Eleven Inc. and a tech startup called Flirtey have beaten Amazon to the punch in making the first drone delivery to a customer’s home in the U.S.

セブンイレブンとテックスタートアップ Flirtey が、米国で初となる、顧客の家庭へのドローン配達によって、Amazonに殴り込みをかけました。

Most already know 7-Eleven, the convenience store retail chain that boasts about 10,800 stores in North America and 59,500 in total around the world.

セブンイレブンは、既にほとんどの人が知っているコンビニエンスストアの小売りチェーン。 北アメリカに10,800店舗、世界ではトータル59,500店舗を誇ります。

- boasts - 自慢する、法螺、力む

Flirtey is a privately held company based in Reno, Nevada, which builds and operates drones to make deliveries that are needed in humanitarian and health work, retail and food industries.

Flirteyは、ネバダ州リノの非公開企業です。 人道的かつ健康への取り組みや、小売業、食品産業において必要とされる、配達を行うドローンを作って運用しています。

- a privately held company - 非公開企業

- humanitarian - 人道的

Rather than adapting existing unmanned aerial vehicles, Flirtey builds its own, develops the software to run them, and creates proprietary packaging and containers to keep items secure during delivery, according to CEO Matt Sweeney.

Flirteyは、配達中にアイテムを安全に維持するため、存在する無人航空機を適応させるのではなく、独自のものを作って、それらを動かすためのソフトウェアを開発し、所有者の梱包とコンテナーを作っています。

- unmanned - 無人の

- aerial vehicles - 航空機

- proprietary - 所有者の

During the 7-Eleven delivery, which took place in Reno, Nevada on July 10th, Flirtey successfully transported: Slurpees, a chicken sandwich, donuts, hot coffee and candy to the home of the family who placed the order.

Flirteyは、7月10日にネバダ州リノで行われたセブンイレブンの配達では、Slurpeesとチキンのサンドイッチ、ドーナツ、ホットコーヒー、そしてキャンディを注文した家庭へ届けることに成功しました。

- Slurpees - セブンイレブンのかき氷的なものですね。日本でも一部店舗であるそうです⇒全国100店舗限定!セブンイレブン幻のフローズンドリンク「SLURPEE(スラーピー)」を飲んできたよ!

While 7-Eleven is thought of as a brick and mortar franchise, the company does actually allow online ordering and delivery through services like Postmates, Tapingo and others. Drones would comprise a futuristic expansion of 7-Eleven’s delivery business.

セブンイレブンは、従来型のフランチャイズと考えられていますが、実際には同社は、PostmatesやTapingoなどのサービスと同様に、オンラインでの注文と配達を行っています。 ドローンはセブン・イレブンの配達事業の未来的な拡張となるでしょう。

- a brick and mortar - 煉瓦とモルタル。「従来型」の意味

- comprise - 成る、含む、占める、包有する。

- expansion - 拡張、展開

And delivery by drone is something 7-Eleven intends to offer widely in the future, according to 7-Eleven EVP and Chief Merchandising Officer Jesus H. Delgado-Jenkins. He declined to put a specific date on the launch of such a service, citing a shifting regulatory environment.

そして、セブン・イレブンのEVPでチーフマーチャンダイジングオフィサーであるJesus H. Delgado-Jenkinsによれば、セブン・イレブンは、ドローンによる配達を将来幅広く提供する意向のようです。彼は、規制の環境が変わることを引用し、そのサービスが投入される具体的な日程は提供しませんでした。

Drone delivery could prove especially useful to families with children who cannot easily leave the house when they have an urgent need for items like over the counter medicines or milk, Delgado-Jenkins said.

ドローンの配達は、簡単には家を離れられない、子供たちを持つ家庭で、市販薬やミルクのようなものが緊急に必要とされるようなとき、特に便利に改善できるはずです。 そう、Delgado-Jenkinsは話しました。

- urgent - 緊急

- the counter medicines - 市販薬

To find customers willing to have their order handled by a flying robot, the companies surveyed households within a one-mile radius of the store from which they planned to deliver.

注文を飛行するロボットで扱われることを望む顧客を見つけるために、同社は、配達の計画をした店舗から半径1マイル以内の世帯の調査を行いました。

- surveyed - 調査した

- household - 世帯

Flirtey’s CEO Matt Sweeney said, “When I moved to the U.S. two years ago, only one company had a 333 exemption to do this and that was in the Arctic!”

FlirteyのCEO Matt Sweeneyは、「私が2年前に米国へ移動したときは、ただ一つの企業だけが、これを行うための333の免除を保有していました。そして、それは北極圏においてだったのです!」

- Arctic - 北極圏

売り上げランキング: 100,873

He sees the milestone delivery as a sign of “rapid progress” not just for his company but the drone industry.

彼は、この配達におけるマイルストーンを、彼の企業だけではなくドローン産業全体のための「急速な進捗」のサインとして見ています。

Indeed, broad changes are ahead for the drones industry in the U.S.

確かに、幅広い変化は、米国でのドローン産業のために、大きく前進します。

The U.S. Federal Aviation Administration is expected to put new rules into effect in late August that allow the operation of small, unmanned aircraft in the national airspace.

米国連邦航空局は、8月の下旬に、領空内での小さな無人航空機の運用を許可する効果に向けて、新たなルールを配備するとされています。

And the FAA Reauthorization Act of 2016, which passed both houses this month, requires the FAA to develop drone delivery rules, and to conduct research on “BVOS” or beyond the visual line of sight flying of drones.

そして、今月両院を通過する、この2016年のFAA再承認法は、FAAに、ドローンの配達ルールを作ること、そして「BVOS」つまりドローンの視界外飛行(Beyond the Visual line Of Sight)についての調査を行うことを要求しています。

売り上げランキング: 492

元記事はこちらからどうぞ。

グーグルBrainの研究者によって明らかにされるマシン・ビジョンのアキレス腱

Machine Vision’s Achilles’ Heel Revealed by Google Brain Researchers

photo credit: System Lock via photopin (license)

売り上げランキング: 2,322

By some measures machine vision is better than human vision. But now researchers have found a class of “adversarial images” that easily fool it.

by Emerging Technology from the arXiv July 22, 2016

いくつかの点においてマシン・ビジョンは人間よりも優れています。 しかし今回、研究者たちは、機械を簡単に騙すことのできる「阻害画像(アドバーサリアルイメージ、敵対的画像)」という分類を見つけました。

- measures - 措置、対策

- adversarial - 訳語としては「敵対的」となるようですが、「adversarial trade」で「阻害貿易」ということだそうなので、ここでは「阻害」としました。英英辞書の説明では「紛争や意見の衝突に関与したり特徴づけられている」と説明されています。

One of the most spectacular advances in modern science has been the rise of machine vision. In just a few years, a new generation of machine learning techniques has changed the way computers see.

現代科学の多くの華々しい進歩の一つが、マシン・ビジョンの台頭でした。 わずか数年で、機械学習技術の新世代が、コンピューターが見る方法を変えてしまいました。

- spectacular - 華々しい、壮観な

Machines now outperform humans in face recognition and object recognition and are in the process of revolutionizing numerous vision-based tasks such as driving, security monitoring, and so on. Machine vision is now superhuman.

今や機械は、顔認識と物体認識で人間をしのぎ、運転やセキュリティモニタリングなどのような、視覚に基づいた多数の仕事を革新していくプロセスにあります。マシン・ビジョンは、 今や超人です。

- outperform - しのぐ

- revolutionizing - 革命

- numerous - 多数の

But a problem is emerging. Machine vision researchers have begun to notice some worrying shortcomings of their new charges. It turns out machine vision algorithms have an Achilles’ heel that allows them to be tricked by images modified in ways that would be trivial for a human to spot.

しかし、ある問題が浮上しています。 マシン・ビジョンの研究者が、それらの新しいチャージ(?)の欠点について、いくつかの心配事に気付き始めました。 人間にとっては簡単に見つけられる、些細に思える方法で修正された画像によって騙されるという弱点(原文はアキレス腱)を、マシン・ビジョンのアルゴリズムが持っていることが判明します。

- shortcomings - 欠点

- charges - 課金、罪状、追加料金

- turns out - 判明

These modified pictures are called adversarial images, and they are a significant threat. “An adversarial example for the face recognition domain might consist of very subtle markings applied to a person’s face, so that a human observer would recognize their identity correctly, but a machine learning system would recognize them as being a different person,” say Alexey Kurakin and Samy Bengio at Google Brain and Ian Goodfellow from OpenAI, a nonprofit AI research company.

これらの修正された写真は阻害画像と呼ばれ、それらは重大な脅威です。 「顔認識の領域での阻害例は、人の顔に施された、とても微妙なマーキングに基づいているかもしれない。 そのため、人間の観察者は正確に、その同一性を認識するだろうが、機械学習システムは、それらを別の人間がいるものとして認識するだろう。」 Google Brain の Alexey Kurakin と Samy Bengio、非営利のAI研究企業である OpenAI の Ian Goodfellowが、このように言っています。

- significant - 重大な。

- threat - 驚異

- subtle - 微妙

Because machine vision systems are so new, little is known about adversarial images. Nobody understands how best to create them, how they fool machine vision systems, or how to protect against this kind of attack.

マシン・ビジョンシステムはとても新しいため、阻害画像については少ししか知られていません。 それらを作るための最高の方法や、いかにしてそれらがマシン・ビジョンを騙すのか、あるいはその攻撃から保護する方法を、だれも理解していないのです。

Today, that starts to change thanks to the work of Kurakin and co, who have begun to study adversarial images systematically for the first time. Their work shows just how vulnerable machine vision systems are to this kind of attack.

最初に阻害画像をシステマチックに研究し始めた Kurakin と仲間の取り組みによって、今日変化が始まります。 彼らの取り組みは、マシン・ビジョンシステムがこの攻撃に対して、どれほど脆弱であるかということを見せています。

The team start with a standard database for machine vision research, known as ImageNet. This is a database of images classified according to what they show. A standard test is to train a machine vision algorithm on part of this database and then test how well it classifies another part of the database.

このチームは、マシン・ビジョンの研究用のImageNetという標準的なデータベースで始めました。 これは、それらが見せているものによって分類された画像のデータベースです。 標準的なテストは、このデータベースの特定部分で、マシン・ビジョンアルゴリズムを訓練することであり、その後、データベースの他の部分を如何にうまく分類するかをテストします。

The performance in these tests is measured by counting how often the algorithm has the correct classification in its top 5 answers or even its top 1 answer (its so-called top 5 accuracy or top 1 accuracy) or how often it does not have the correct answer in its top 5 or top 1 (its top 5 error rate or top 1 error rate).

これらのテストのパフォーマンスは、このアルゴリズムが出した上位5つ、または1つの答えの中に、正しい分類がどれほど多く含まれているか、または含まれていないかを数えることで測られます(これは上位5つの精度、または上位1つの精度、そして、上位5つのエラー率、上位1つのエラー率と呼ばれます)。

One of the best machine vision systems is Google’s Inception v3 algorithm, which has a top 5 error rate of 3.46 percent. Humans doing the same test have a top 5 error rate of about 5 percent, so Inception v3 really does have superhuman abilities.

最高のマシン・ビジョンシステムの一つは、グーグルの Inception v3 アルゴリズムで、これは、上位5つのエラー率が、3.46パーセントです。 人間が同じテストをすれば約5パーセントですから、Inception v3 は正に超人的能力を持っています。

Kurakin and co created a database of adversarial images by modifying 50,000 pictures from ImageNet in three different ways. Their methods exploit the idea that neural networks process information to match an image with a particular classification. The amount of information this requires, called the cross entropy, is a measure of how hard the matching task is.

Kurakinのチームは、ImageNetの5万枚の写真を、3つの違った方法で修整することにより阻害画像のデータベースを作りました。 彼らの手法は、特定の分類によって画像を一致させるために、ニューラルネットワークが情報を処理するという考えを開発しています。 これに必要となる情報量は、クロス・エントロピーと呼ばれ、マッチングのタスクが難しいのかの尺度です。

- exploit - 開発する

Their first algorithm makes a small change to an image in a way that attempts to maximize this cross entropy. Their second algorithm simply iterates this process to further alter the image.

彼らの最初のアルゴリズムは、このクロス・エントロピーを最大化を試みる方法で、画像を少し変化させました。彼らの2つ目のアルゴリズムは、画像を少し変化させるために、この処理を単純に繰り返すものです。

These algorithms both change the image in a way that makes it harder to classify correctly. “These methods can result in uninteresting misclassifications, such as mistaking one breed of sled dog for another breed of sled dog,” they say.

これらのアルゴリズム両方が、正確な分類を難しくするように画像を変更します。 「これらの手法が、そりを引く犬の1品種を他の品種に間違うような面白くない誤分類の結果を出せるのです。」 彼らはこのように言います。

Their final algorithm has much cleverer approach. This modifies an image in way that directs the machine vision system into misclassifying it in a specific way, preferably one that is least like the true class. “The least-likely class is usually highly dissimilar from the true class, so this attack method results in more interesting mistakes, such as mistaking a dog for an airplane,” say Kurakin and co.

彼らの最終的なアルゴリズムは、かなり、より賢いアプローチをとっています。 これはマシン・ビジョンシステムに誤分類させるように画像を修正します。 むしろ真の分類に一番似ていない、特定のやりかたです。 「この最低類似分類は通常は真の分類とは大きく異なります。ですから、この攻撃手法は、犬を飛行機に間違えたりするような、より興味深い間違いの結果を出します。」 Kurakinのチームは言っています。

- directs - 【動詞】指示を出す、~させる

- preferably - 望ましくは、むしろ、できれば、

- dissimilar - 異なる

They then test how well Google’s Inception v3 algorithm can classify the 50,000 adversarial images.

彼らは、そこで、グーグルの Inception v3 アルゴリズムがどれほどうまく5万枚の阻害画像を分類するかをテストします。

The two simple algorithms significantly reduce the top 5 and top 1 accuracy. But their most powerful algorithm—the least-likely class method—rapidly reduces the accuracy to zero for all 50,000 images. (The team do not say how successful the algorithm is at directing misclassifications.)

2つの単純なアルゴリズムは、トップ5精度とトップ1精度をかなり減らしました。 しかし、彼らの最もパワフルなアルゴリズム ― 最低類似手法 ― は、5万枚の画像に対して、その精度を急速にゼロまで減らしました。 (このチームは、誤分類させる、そのアルゴリズムがどのようにして成功したのかについて話していません。)

That suggests that adversarial images are a significant threat but there is a potential weakness in this approach. All these adversarial images are fed directly into the machine vision system.

これは、阻害画像は重大な脅威であるということを示唆していますが、このアプローチに弱点となる可能性があります。 全てのこれらの阻害画像は、マシン・ビジョンシステムに直接与えられたものです。

- fed - feedの過去分詞。与える

But in the real world, an image will always be modified by the camera system that records the images. And an adversarial image algorithm would be useless if this process neutralized its effect. So an important question is how robust these algorithms are to the transformations that take place in the real world.

しかし、現実の世界では、画像は常に、画像を記録するカメラシステムによって修正されます。 そして、阻害画像のアルゴリズムは、もしこの処理がその効果を中和したならば、使用できないでしょう。 ですから、これらのアルゴリズムが、現実世界の場所を占める変換まで、いかに堅牢であるかということが重要な問題です。

To test this, Kurakin and co print out all the adversarial images along with the originals and photograph them by hand with a Nexus 5 smartphone. They then feed these transformed adversarial images into the machine vision system.

これをテストするために、Kurakinのチームはすべての阻害画像をオリジナルと一緒に印刷し、Nexus 5 スマートフォンで撮影しました。 彼らはそして、これらの変換された阻害画像をマシン・ビジョンシステムへ与えます。

Kurakin and co say that the least-likely class method is the most vulnerable to these kinds of transformations but that the others bear up reasonably well. In other words, adversarial image algorithms really are a threat in the real world. “A significant fraction of adversarial images crafted using the original network are misclassified even when fed to the classifier through the camera,” say the team.

Kurakinのチームは、最低類似分類手法は、これらの変換種類に対して、もっとも脆弱であったが、他はほどほどにうまく耐えました。 言い換えれば、現実世界において、阻害画像のアルゴリズムが実際に脅威だということです。 「カメラを通じて分類器に与えられたとしても、オリジナルのネットワークを使用して作られた阻害画像のかなりの割合が誤分類されました。」 そのように、このチームが言っています。

- bear up - 耐える

- reasonably - 合理的に、ほどほどに

That’s interesting work that throws some important light on machine vision’s Achilles’ heel. And there’s plenty of work ahead. Kurakin and co want to develop adversarial images for other kinds of vision systems and make them even more effective.

これは興味深い取り組みです。マシン・ビジョンの弱点に当てられた、いくつかの重要な光を投げかけているのです。 そして、多くの仕事が前方に存在します。Kurakinのチームは、他の視覚システムのために、阻害画像を開発し、少しでも効果的にしたいのです。

All this will raise some eyebrows in the computer security community. Machine vision systems are now better than humans at recognizing faces, so it’s natural to expect them to be used to for everything from unlocking smartphones and front doors to passport control and bank account biometrics. But Kurakin and co raise the prospect of fooling these systems with ease.

このすべてが、コンピューターセキュリティのコミュニティを驚かせるでしょう。 マシン・ビジョンシステムは今や顔認識において人間よりも上手いので、当然のように、スマートフォンや玄関のロックを外すことから、入国管理や銀行口座のバイオメトリックスまでの全てにおいて使用されることが期待されています。 しかし、これらのシステムを簡単にだませるという見通しをKurakinのチームが掲げているのですから。

- prospect - 見通し

- raise eyebrows - 眉を挙げる、眉をひそめる(賛成しない)、驚かせる

In the last couple of years we’ve learned a lot about how good machine visions systems can be. Now we’re just finding out how easily they can be fooled.

直近の2年で、マシン・ビジョンシステムがどれほど良くなれるのかということについて、私たちは多くを学びました。 今、私たちは、それらが如何に簡単にだまされるのかということを、見つけ出したところです。

Ref: arxiv.org/abs/1607.02533 : Adversarial Examples in the Physical World

原文はこちらからどうぞ。

「ポケモンGo」って何?なんで誰もがポケモンGoの話をしている?

What is Pokémon Go and why is everybody talking about it?

This new Pokémon game is bringing augmented reality mainstream.

この新しいポケモンのゲームは拡張現実をメインストリームへもたらしています。

売り上げランキング: 8

Why is everyone suddenly talking about Pokémon?

なぜ、みんなが突然ポケモンについて話し始めたのか?

That’s the question I’ve been asking myself after navigating a Pokémon-related social media hailstorm the last few days, complete with witty tweets and jokes, and even great videos, like this one of my boss, Recode Editor in Chief Dan Frommer, catching his first Pokémon at a Mets game.

これは、私が、ここ数日の、ポケモンに関連したソーシャルメディアでの嵐を紹介した後、自分自身に尋ねてみた質問です。 ウィットのきいたつぶやきとジョーク、さらに素晴らしい映像で完成されている。 Metsのゲームで彼にとっての最初のポケモンを捕まえている、私の上司、Recodeの編集長である Dan Frommerのように。

I like Pokémon. I played with the cards as a kid — the game is 21 years old. But I was perplexed recently to see everyone talking about Pokémon Go, a new mobile game that seemed to come out of nowhere. (It has actually been in the works for some time.)

私はポケモンが好きです。子供の頃は、そのカードで遊びました - このゲームは21年前のものです。 しかし、私は最近、どこからともなく現れたように見える(実際にはいくらかの時間取り組まれていました)新しいモバイルゲーム「ポケモンGo」について誰もかもが、語っているの見て当惑しました。

- perplexed - 当惑した

So, while most of America started a quest to "catch ’em all" — that is, capture all the pretend Pokémon in the game — I set out on a different quest, a quest to figure out what in the name of sweet baby Pikachu this Pokémon Go was and where it came from.

ですから、多くのアメリカ人が「彼らを全部捕まえる 」― ゲームの中のポケモンを捕まえる ― ための探検を始めている間、私は別の探検を準備しました。 かわいらしい赤ちゃんピカチュウの名前は何なのか、そして、ポケモンGoはどこからやってきたのかを知るための探検です。

What is Pokémon Go?

ポケモンGoって何ですか?

It’s a new mobile game, free on both iOS and Android, that lets you create an avatar that can catch, train, trade and battle Pokémon characters inside the game.

iOSとAndroidの両方で無料で遊べる新しいモバイルゲームです。 ゲームの中で、あなたが作成したアバターで、ポケモンのキャラクターを捕まえて訓練し、取引して戦わせることができるのです。

That sounds familiar. Isn’t that the premise of virtually every other Pokémon game?

おなじみのものに聞こえます。それは、事実上の他のすべてのポケモンのゲームの前提ではないのですか?

- premise - 前提

Yes, kinda. What makes this game unique is that it uses your phone’s location services and camera so that you can catch Pokémon in real life. That is, when you walk around the streets of whatever city or town you live in, your avatar moves inside the game. So finding new Pokémon and checkpoints for the game actually requires you to get off the couch and walk down the block.

まあ、そうですけど、このゲームをユニークなものにしているのは、あなたのスマホの位置情報サービスとカメラを使用することなのです。 このため、あなたは現実の生活の中でポケモンを捕まえることができるのです。 それは、あなたが住んでいる街や近所の道を歩いているとき、あなたのアバターがゲームの中で動きます。 つまり、新しいポケモンや、このゲームのチェックポイントを見つけるために、あなたはソファから降りて、そのブロックを歩くことが必要です。

How does this work?

どのように動作するの?

The game uses Google Maps technology to place your avatar on a virtual world that mirrors your real life surroundings. When you find a Pokémon, the game uses augmented reality to make it look like whatever Pokémon you’ve stumbled across is indeed standing right there in front of you.

このゲームは、あなたの現実の生活での周辺を、仮想世界の、あなたのアバターの位置に反映させるために、グーグルマップの技術を使用しています。あなたがポケモンを見つけたとき、このゲームは、あなたが遭遇したポケモンが、まさにあなたの正面に立っているように見えるように、拡張現実を使用します。

Here’s a YouTube video that gives you an idea of what I mean:

YouTubeのビデオをどうぞ。私の言っていることの意味がわかりますよ。

Who created Pokémon Go?

誰がポケモンGoを作ったの?

Nintendo and the other creators of Pokémon teamed up with Niantic Labs to create the game. The former company was born inside Google; its founder, John Hanke, was a key leader of its Geo products (Google Maps, Earth). After moving to leave Google in 2010, Hanke was lured to stay with funding for Niantic, a skunkworks project to build mobile AR tools using Google Maps technology. Niantic’s first effort, Ingress — an augmented-reality, massively multiplayer, location-based online game — cultivated a small but very dedicated following. Niantic spun out of Google in the fall, yet the search giant stayed involved, participating in a $30 million investment for developing Pokémon Go.

Is there a good reason you’re telling me all about this now?

今、これについてあなたが私に話をしていることの良い理由がありますか?

Sort of! For starters, it’s the talk of the internet at the moment, and the technological elements around AR and location are getting a lot of attention. Plus, this game is helping the idea of AR move mainstream, so you may stumble across references to it in places you didn’t expect to. Like when Washington state’s Department of Transportation tweeted out a plea so people wouldn’t go "Pokémoning from behind the wheel." Plus, Nintendo stock was up 10 percent Friday, thanks to the game’s immediate popularity.

If your weekend includes looking for #Eevee on #PokemonGO, please do so safely. No Pokemoning from behind the wheel. pic.twitter.com/Kt9CmTOKiP

— Washington State DOT (@wsdot) 2016年7月8日

What’s the weirdest thing that’s happened with someone playing Pokémon Go so far?

これまで、ポケモンGoを誰かが遊ぶことで発生した、一番妙なことは何?

I’m glad you asked. A 19-year-old Wyoming woman found a dead body while looking for Pokémon near a river by her house. Pretty absurd.

元記事はこちら。